Quantas vezes você abriu o Google Analytics hoje?

Agora a pergunta importante: e quantas vezes você abriu o access log da sua loja?

Essa é a separação que pretendo deixar clara neste texto. A maior parte das pessoas que opera um e-commerce no Brasil acompanha religiosamente o público humano – sessões, taxa de conversão, ticket médio, origem de tráfego. E ignora completamente o outro público que entra na loja todos os dias: bots, crawlers, agentes de LLM.

Esse segundo público não é minoria. Em muitas operações, ele responde por mais da metade das requisições que chegam ao servidor. E, a partir de agora, ele decide se sua loja vai aparecer – ou não – quando alguém pergunta para o ChatGPT, Gemini, Claude ou Perplexity onde comprar um produto.

“A maior parte do tráfego da sua loja não é de gente. E você nunca olhou pra isso.”

Este post é uma adaptação da palestra que apresentei na Arena E-commerce Brasil do Gramado Summit 2026.

A estrutura segue o mesmo arco: primeiro a revelação de que esse público existe, depois o diagnóstico do que ele está fazendo com a sua infraestrutura, em seguida a virada – porque até ontem esses agentes vinham ler, e agora eles vêm comprar – e finalmente o que você, como lojista, pode fazer hoje, sem depender da sua plataforma.

A revelação: quem são essas visitas

Antes de qualquer análise, é preciso enxergar.

E enxergar bots no e-commerce hoje significa olhar o access log com um filtro adequado. Foi exatamente isso que motivou o desenvolvimento do BotIAudit – uma ferramenta interna que cruza access logs de lojas reais e identifica o comportamento de cada agente.

Quando você roda esse tipo de análise pela primeira vez, descobre que existem diversos bots que aparecem com frequência no access log de qualquer e-commerce de porte médio para cima.

Alguns são bem conhecidos: Googlebot, Bingbot, Yandex, AhrefsBot, SemrushBot, FacebookExternalHit.

Já os novatos são os que mudam o jogo.

Os quatro novos visitantes que importam

- GPTBot e CCBot: coletam conteúdo para treinamento de modelos da OpenAI e Common Crawl.

- ChatGPT-User e OAI-SearchBot: fazem inferência em tempo real. Quando alguém pergunta no ChatGPT por um produto, esses agentes consultam sua loja na hora.

- ClaudeBot e Claude-User: o equivalente da Anthropic. ClaudeBot para treinamento, Claude-User para inferência.

- PerplexityBot: agente da Perplexity, que opera com modelo de citação contínua e tende a indexar com mais agressividade que os demais.

A distinção que muda tudo: nem todo bot vem pelo mesmo motivo

Tratar todos os bots como uma massa única é o primeiro erro. Existem três categorias funcionais distintas, e a estratégia para cada uma é diferente:

Crawlers tradicionais

Googlebot, Bingbot, Yandex, Baidu. Indexam conteúdo para mecanismos de busca. É o público que o SEO clássico endereça há vinte anos.

LLMs em treinamento

CCBot, GPTBot, ClaudeBot. Coletam conteúdo em larga escala para alimentar a próxima geração de modelos. Aparecem em janelas, fazem rastreamento profundo, e impactam a infraestrutura – geralmente sem retornar nada de imediato em forma de tráfego.

LLMs em inferência

ChatGPT-User, Claude-User, PerplexityBot, OAI-SearchBot. São os que mais importam comercialmente hoje.

Quando um usuário pergunta para uma IA “qual o melhor notebook para edição de vídeo até R$ 8 mil?”, são esses agentes que entram na sua loja em tempo real para responder.

Se sua loja estiver bem estruturada, o produto sai como resposta. Se não, sai o do concorrente.

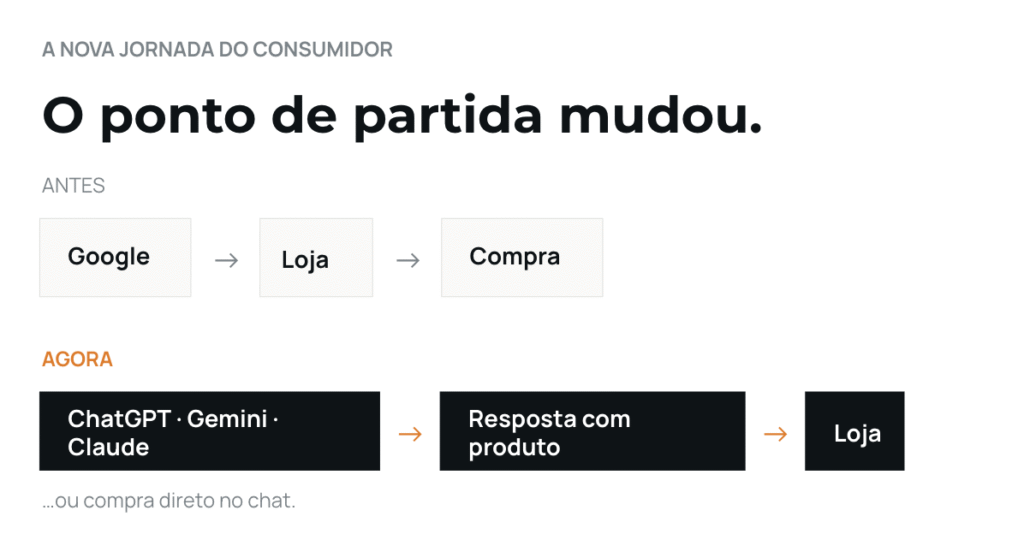

A nova jornada de descoberta de produto

O ponto de partida da jornada de compra mudou. Não inteiramente, não da noite para o dia – mas o suficiente para forçar uma releitura do funil.

Para o lojista, isso significa uma coisa concreta e nova: o seu produto pode estar sendo recomendado – ou não – em uma conversa entre um consumidor e uma IA, sem que você jamais saiba que aquela interação existiu.

Não há referrer rastreável no padrão tradicional. Não há sessão de Analytics. A descoberta acontece num espaço que você não mede.

“Mas isso ainda é pouco tráfego” – e por que isso não importa

É o argumento mais comum quando levanto esse tema: “Leandro, AI referral ainda é menos de 1% do tráfego total. Estamos discutindo o quê?”. E é verdade – a fatia ainda é pequena.

Mas três dados mudam completamente a leitura desse número:

[imagem números que importam]

Um canal que cresce 155% em oito meses e converte três vezes mais que a média deixa de ser um detalhe estatístico. Vira o canal mais eficiente da sua matriz – só que invisível.

E quem está otimizando a loja para esse canal hoje, no Brasil, é uma minoria muito pequena.

“Esses agentes decidem hoje se sua loja aparece na resposta de uma IA. Quem está otimizando sua loja para eles?”

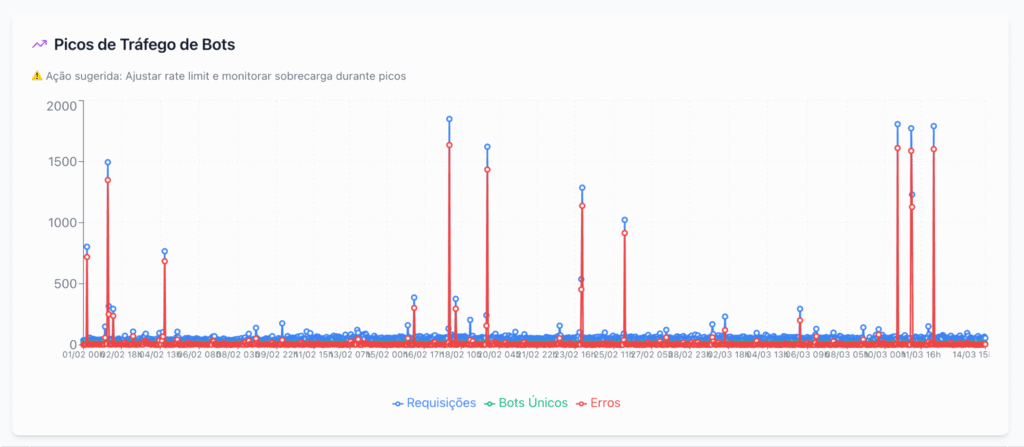

O diagnóstico: o que esses visitantes fazem com sua infraestrutura

Reconhecer que esse público existe é o passo um.

O passo dois é entender o que ele está fazendo agora mesmo – e como isso afeta três frentes simultâneas: sua infraestrutura, sua segurança e sua presença em respostas geradas por IA.

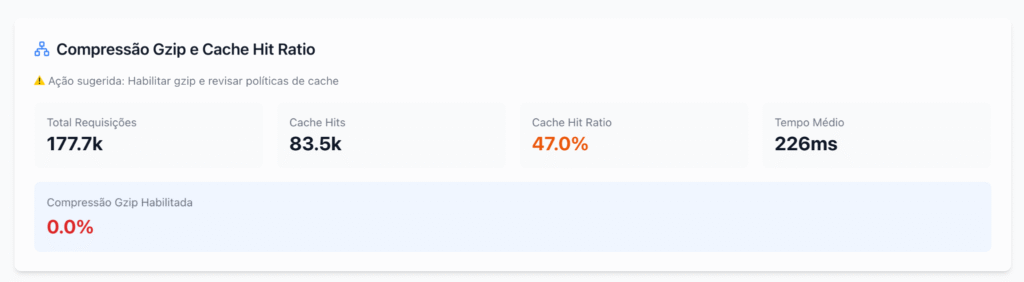

Sua infraestrutura queimando dinheiro

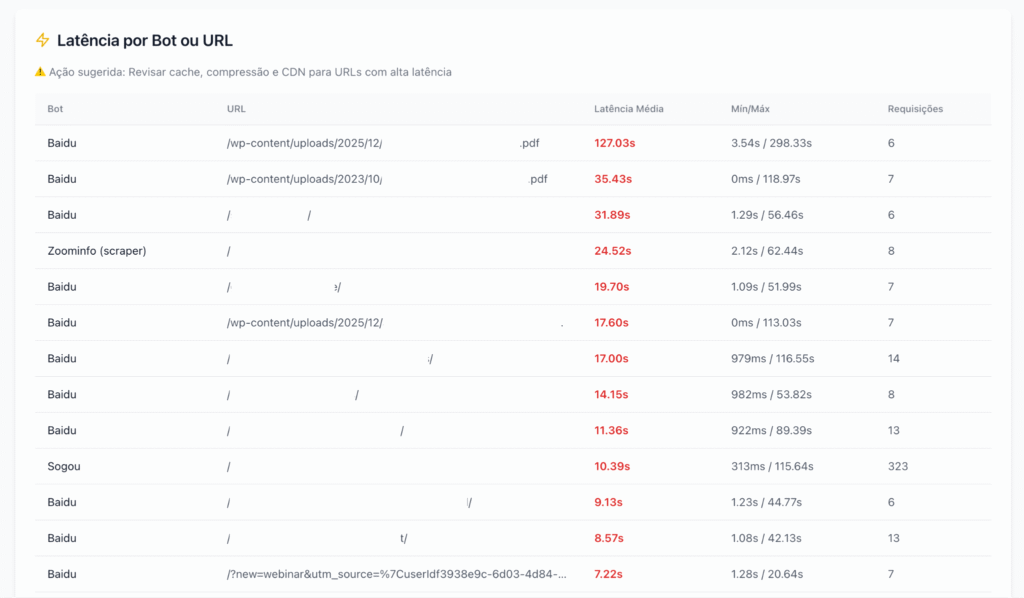

Quando você roda uma análise de cache hit ratio segmentada por bot, encontra padrões que não aparecem em uma análise agregada.

Em uma loja real que auditamos recentemente, 53,6% das requisições estavam batendo direto no servidor de origem – sem aproveitamento do cache. Pior: gzip estava desabilitado no servidor. Conteúdo trafegando sem compressão, banda jogada fora a cada requisição.

Isso é dinheiro saindo, literalmente.

Cada requisição não cacheada custa CPU, custa banda, custa tempo de resposta. E os bots de LLM são particularmente vorazes – fazem rastreamento profundo, baixam arquivos completos, voltam várias vezes ao mesmo recurso.

Um exemplo concreto que tiramos de um access log:

Sua segurança em risco

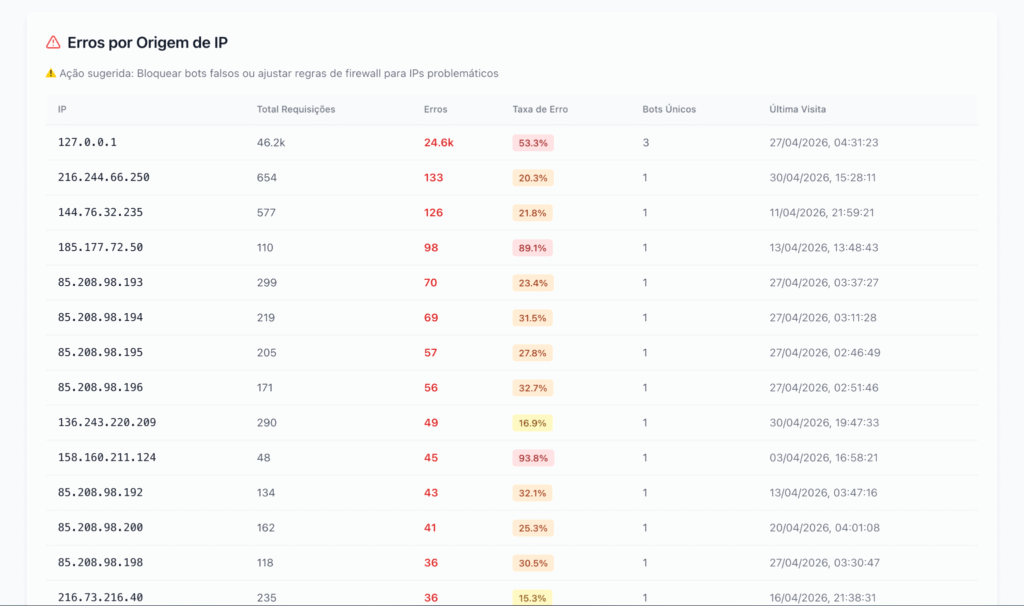

A segunda frente é segurança.

Quando você olha o access log com filtro por código de status, identifica padrões que não são bot legítimo – são tentativa de invasão, varredura de vulnerabilidade, bruteforce.

Em uma loja que auditamos, um único IP fez 110 requisições e gerou 98 erros 4xx ou 5xx – uma taxa de falha de 89,1%.

Não é tráfego acidental.

Cada uma daquelas linhas vermelhas na tabela é alguém tentando abrir uma porta.

Pode ser scan de wp-login.php, tentativa de SQL injection em parâmetros de busca, varredura por arquivos sensíveis.

O custo real disso não é só infraestrutura – é o risco de uma dessas tentativas eventualmente passar.

User agents falsificados: nem todo bot é quem diz ser

Um detalhe adicional que merece atenção: o user agent é um campo declarativo.

Qualquer requisição pode dizer que é “LinkedInBot/1.0” ou “Googlebot/2.1”. Não há autenticação embutida no protocolo HTTP que prove isso.

Na prática, isso significa que parte do que aparece no seu access log como “Googlebot” pode ser um scraper, um competitor monitorando preços, ou um agente malicioso se passando por bot legítimo.

A verificação correta combina três coisas:

- Reverse DNS lookup: bots oficiais resolvem para domínios autorizados (googlebot.com, search.msn.com etc.).

- Cross-check com faixas de IP publicadas pela própria empresa (Google, Microsoft e OpenAI publicam ranges oficiais).

- Análise de comportamento contra a baseline conhecida do bot.

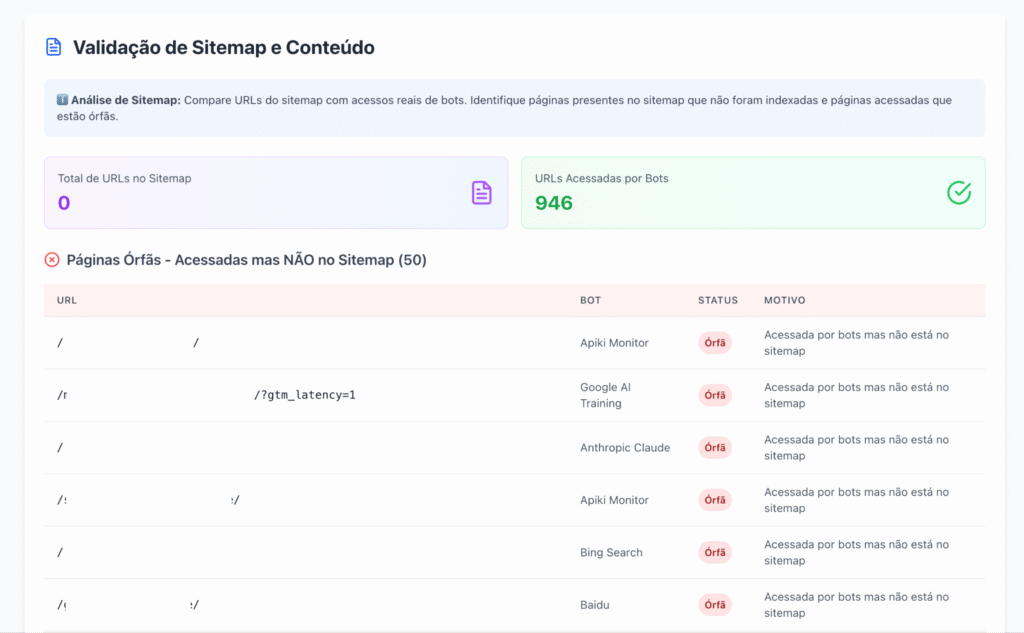

Você sumindo das respostas geradas pelas IAs

A terceira frente é a mais nova e a que mais surpreende quando os números aparecem.

Trata-se de medir, dentro do access log, se os agentes de LLM conseguem efetivamente ler e indexar a sua loja – ou se estão batendo em erros, redirects quebrados, conteúdo bloqueado por robots.txt mal configurado.

Páginas órfãs: você diz “vá aqui”, e eles vão em outro lugar

Em uma das auditorias, identificamos 50 páginas que os bots estavam acessando ativamente e que sequer constavam no sitemap.xml da loja.

Páginas de produto antigas indexadas no Google e abandonadas, rotas de filtro com parâmetros, URLs órfãs deixadas por migrações anteriores.

Isso é particularmente grave no contexto de LLM porque o sitemap é um sinal forte para os agentes de inferência.

Quando o que ele encontra na navegação real não bate com o que você declarou no sitemap, a confiança no domínio cai – e a probabilidade da sua loja ser citada como fonte cai junto.

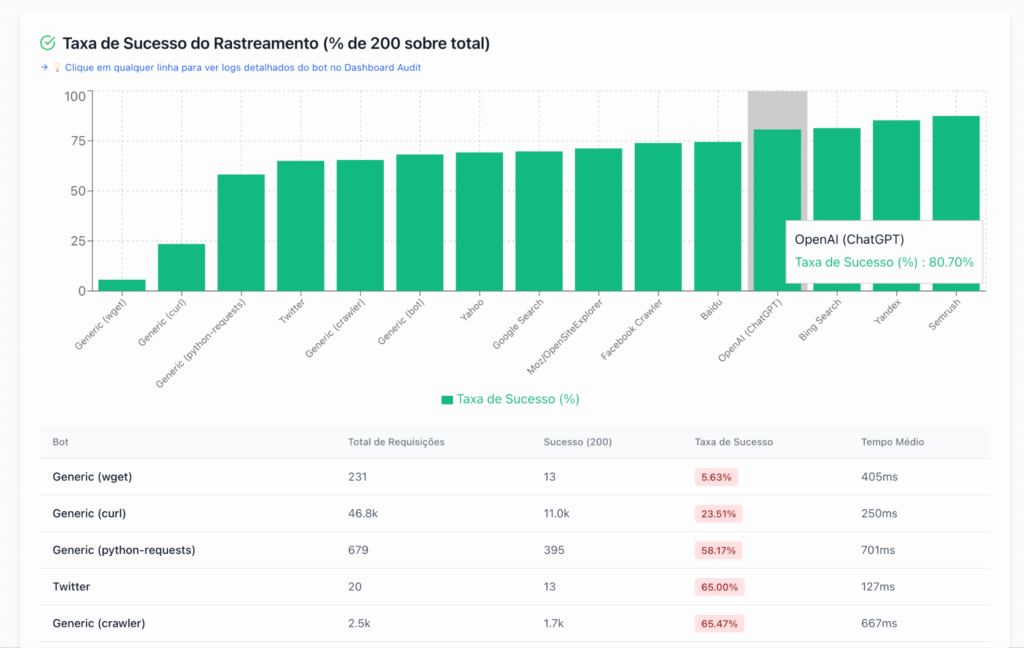

Taxa de sucesso de rastreamento: o número que ninguém olha

E o dado mais incômodo da série. Quando segmentamos o access log por bot específico e medimos a taxa de respostas 2xx (sucesso) versus 4xx/5xx (erro), o ChatGPT-User apresentou, em uma loja específica, taxa de sucesso de 80,92%.

A virada conceitual do SEO: a pergunta não é mais a mesma

A consequência prática de tudo isso é que a pergunta que guiava SEO há duas décadas perdeu sua precisão.

Não basta perguntar “eu apareço no Google?”. A pergunta de 2026 em diante é mais ampla, e bem mais difícil de responder:

“O ChatGPT consegue me ler, entender, confiar e me recomendar?”

Esses quatro verbos são quatro disciplinas distintas:

- Ler: sua loja responde rapidamente, sem erros, com conteúdo acessível ao agente;

- Entender: seu HTML usa schema.org de forma consistente, sua estrutura semântica é coerente, seu feed de produto é confiável;

- Confiar: o domínio tem reputação, as informações são estáveis no tempo, não há contradições entre páginas;

- Recomendar: você é citado em fontes que o modelo já considera autoritativas, e o conteúdo da loja resolve a intenção da pergunta de quem está perguntando.

Essa disciplina nova começou a ser nomeada na indústria como AEO (Answer Engine Optimization) e GEO (Generative Engine Optimization).

Os termos vão se consolidar, mas o fenômeno já está aqui.

Resumo do diagnóstico

Três coisas estão acontecendo simultaneamente, agora, no seu e-commerce, sem que você esteja olhando:

- Infraestrutura queimando recursos com cache mal calibrado, gzip ausente, latência alta para bots específicos.

- Superfície de ataque crescendo com IPs suspeitos testando portas e user agents falsificados se passando por bots legítimos.

- Você sumindo das respostas geradas porque os agentes de LLM encontram erros, páginas órfãs e baixa taxa de sucesso ao tentar ler sua loja.

A virada: até ontem vinham ler. Agora vêm comprar.

Aqui é onde a história fica desconfortável – porque até este ponto, estamos discutindo um problema operacional. A partir daqui, é uma decisão estratégica.

Tudo o que descrevi até agora trata do que acontece quando agentes de LLM acessam sua loja para responder perguntas.

Eles leem, eles citam, eles recomendam – mas a transação, idealmente, acontece no seu domínio. Esse é o cenário atual da maioria das interações.

O cenário que está chegando – e em alguns casos já chegou – é o de agentic commerce: agentes que executam a compra inteira dentro do próprio chat, sem o usuário pisar no seu site.

E isso traz uma escala que vale olhar.

O tamanho do público

Esse é o universo de descoberta de produto que opera, hoje, fora do Google. E é nele que a próxima camada – a transacional – está sendo construída.

A nova pilha do Agentic Commerce

Cinco protocolos abertos estão sendo padronizados pela indústria, cada um responsável por uma camada da infraestrutura de comércio com agentes:

MCP · Model Context Protocol (Anthropic)

É a base. Define como LLMs acessam dados e ferramentas externas de forma padronizada. Sem MCP, nada do que vem depois funciona como pilha unificada.

A2A · Agent2Agent (Google)

Define como agentes diferentes cooperam entre si – o agente que descobre o produto conversa com o agente que processa a compra, com o agente que consulta o estoque, e assim por diante.

AP2 · Agent Payments Protocol

Camada de pagamento. Padroniza como um agente autoriza e processa uma transação em nome do usuário, com os controles e limites adequados.

ACP · Agentic Commerce Protocol (OpenAI + Stripe)

Open-source, já em produção dentro do ChatGPT, co-desenvolvido pela OpenAI com a Stripe. Define o fluxo de comércio do lado do agente que faz a compra. Documentação em developers.openai.com/commerce.

UCP · Universal Commerce Protocol (Google + indústria)

A pilha completa de checkout, identidade e pedidos. Padrão aberto, endossado por players de pagamento e varejo global. Documentação em ucp.dev.

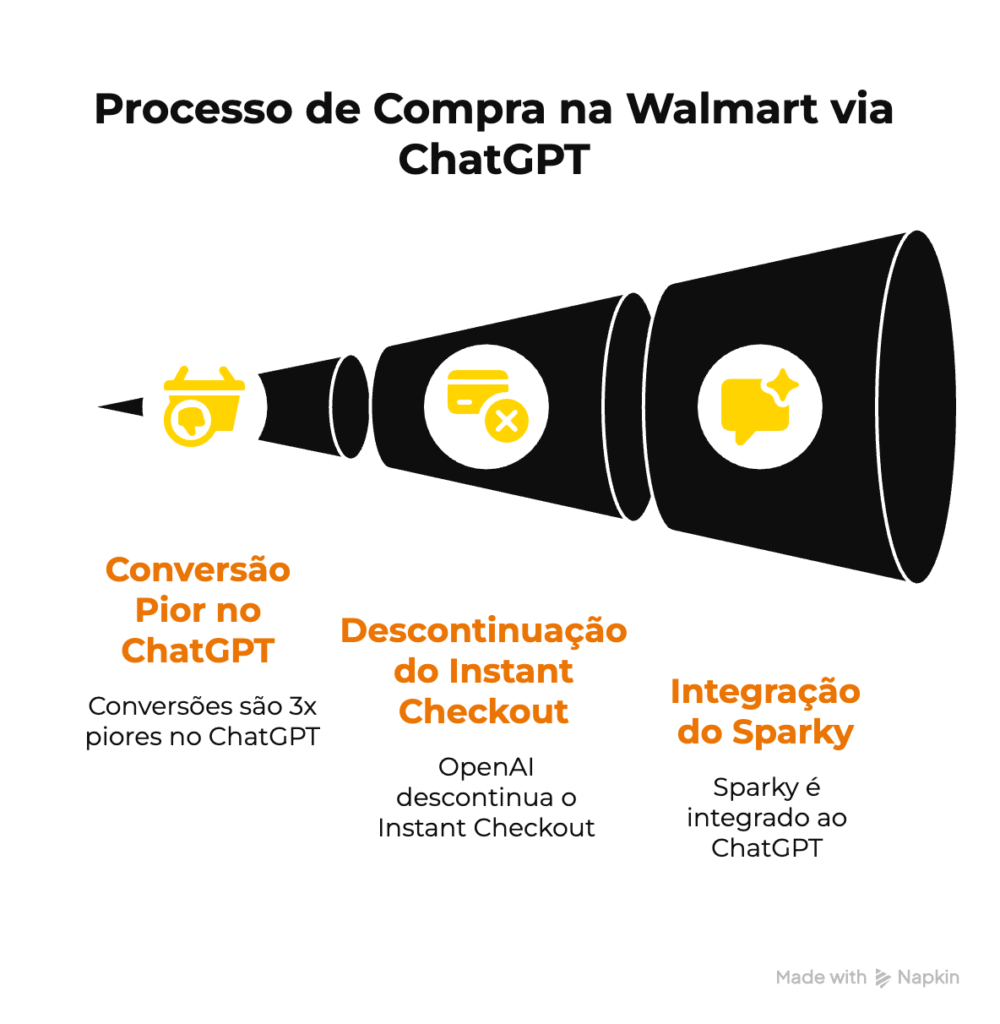

O dado que ninguém estava esperando: Walmart, 19 de março de 2026

E aqui entra o achado que reorganizou as prioridades dos times de e-commerce mais avançados, na minha leitura.

Em 19 de março de 2026, surgiram análises públicas sobre a experiência da Walmart como launch partner original do Instant Checkout da OpenAI dentro do ChatGPT.

O que aconteceu

- A Walmart testou cerca de 200 mil produtos disponíveis para compra via ACP, dentro do ChatGPT;

- A conversão das compras feitas dentro do ChatGPT foi cerca de 3× pior do que quando o usuário clicava para o site da Walmart;

- Em paralelo, a OpenAI anunciou a descontinuação do Instant Checkout no formato original;

- A Walmart hoje integra o Sparky dentro do ChatGPT como assistente – descoberta acontece no chat, conversão acontece no domínio próprio.

“Descoberta acontece na IA. Conversão acontece no seu domínio. E isso muda tudo sobre o que você precisa otimizar.”

Esse insight é uma boa notícia para a maioria dos lojistas brasileiros.

Significa que o esforço prioritário não é, neste momento, montar uma loja vendendo dentro do ChatGPT. É garantir que, quando o agente de IA recomendar sua loja, a transição para o seu domínio aconteça de forma fluida e a conversão complete.

O que muda é que esse domínio precisa estar legível para o agente, rápido o suficiente para a inferência, e estruturado de forma que o agente possa, eventualmente, executar parte do checkout em fluxos futuros – quando a indústria amadurecer.

O paralelo histórico: quem chega depois sempre paga mais caro

Esse é o terceiro momento de virada estrutural do ambiente digital comercial que vivenciamos em três décadas. E os dois primeiros têm uma lição em comum:

- 1995: sites existem, mas busca ainda não está organizada. Quem entrou cedo definiu domínios, definiu pautas, virou autoridade;

- 2005: Google amadurece, e sites bem estruturados ganham relevância massiva. Quem entendeu SEO em 2005 ainda colhe resultados de 2025. Quem entrou em 2015, paga muito mais caro pelo mesmo posicionamento;

- 2026: agentic commerce começa. Lojas estruturadas para agentes começam a aparecer nas respostas das IAs. Os princípios de quem se mexe agora vão pesar pelos próximos dez anos.

“Se isso é padrão de indústria… por que a adoção ainda está tão baixa no Brasil?”

O lojista no centro: o que depende de você

Chegamos no ponto que importa.

Tudo que descrevi até aqui é diagnóstico e contexto.

A pergunta prática é: o que você, lojista, consegue fazer agora – sem depender da sua plataforma de e-commerce evoluir, sem esperar fornecedor, sem precisar reescrever o stack?

Existem três camadas que estão sob seu controle direto.

As três precisam ser endereçadas, e a ordem importa.

Camada 1: Visibilidade

“Você não otimiza o que não mede.”

Antes de qualquer iniciativa, três perguntas precisam ter respostas clara, atualizada, idealmente em dashboard:

- Quais bots e LLMs acessam sua loja hoje? Em qual volume, com qual frequência, em quais rotas?

- Quais são amigos, quais são inimigos? Quais agregam valor (indexação útil, citação em IA), quais consomem recurso sem retorno (scrapers, bots maliciosos, crawlers de baixa relevância)?

- O que eles pedem, e o que eles erram? Quais rotas eles batem com sucesso, em quais encontram 404, 500, redirects mal configurados?

Sem esse diagnóstico, qualquer ação nas próximas camadas é tiro no escuro. É por isso que construímos o BotIAudit – para responder essas três perguntas de forma estruturada e recorrente.

Camada 2: Legibilidade

Sua loja precisa ser entendida por uma máquina. E isso não significa apenas “ter SEO técnico em dia”.

Significa quatro frentes específicas:

- Schema.org consistente em todo o catálogo. Cada produto com Product schema completo, cada categoria com BreadcrumbList, cada review com Review schema. Consistência é mais importante que extensão;

- Feed de produto coerente. Preço, estoque, frete, prazo, disponibilidade – todas as informações que aparecem ao consumidor precisam estar acessíveis também via feed estruturado, e bater com o que está no HTML;

- Políticas em linguagem clara. Troca, devolução, garantia, prazo. Páginas curtas, diretas, sem juridiquês. O agente lê isso para responder “essa loja tem boa política de devolução?”;

- APIs documentadas e estáveis. Se sua loja oferece consulta de estoque, simulador de frete ou rastreamento de pedido por endpoint, esses endpoints precisam ter documentação pública e estabilidade de contrato.

“Isso não depende da sua plataforma. Depende do seu trabalho.”

Camada 3: Transacionabilidade

Aqui mora a decisão estratégica de 2026. Três caminhos coexistem, cada um com seu custo:

Caminho 1: esperar a plataforma chegar lá

Baixo custo agora, mas alto custo depois. Você fica refém do roadmap do seu fornecedor, e perde os primeiros dois ou três anos de janela competitiva – o equivalente ao SEO de 2005.

Caminho 2: implementar protocolo aberto agora

Os protocolos descritos no Ato 3 (MCP, ACP, UCP, AP2) têm especificações públicas, SDKs e repositórios no GitHub. Para lojas com time técnico, é viável começar com um piloto controlado em parte do catálogo.

Caminho 3: construir com parceiro especializado

Para lojas que não têm bandwidth de engenharia interna mas precisam se mexer agora, o caminho é trazer um parceiro que já entenda os protocolos, os bots, e a interseção entre infraestrutura, SEO e agentic commerce.

É exatamente o espaço onde a Apiki opera com WP Host, WP Care e WP Growth.

Cada caminho tem custo. Ignorar também tem – e provavelmente é o mais caro dos quatro, considerando o horizonte de cinco a dez anos.

“O agentic commerce não é um produto que você compra. É uma capacidade que você constrói.”

Três perguntas para você fazer agora

Saia desta leitura com três perguntas simples e diretas.

Se você não tem resposta concreta para alguma delas, está a um passo de virar a resposta que outro lojista vai dar no lugar do seu produto.

- Você sabe quais LLMs acessam sua loja hoje, em que volume e em quais rotas?

- Sua loja está estruturada para ser lida por um agente – schema consistente, feed coerente, políticas claras, APIs documentadas?

- Quando o primeiro pedido vier de um agente, você vai saber?

O Gramado Summit deste ano se chamou Make It Human. Mas se o humano delegou a compra para um agente, entender o agente é entender o novo humano.

“Sua loja tem dois públicos. Um deles você conhece há anos. O outro acabou de sair do chat de uma LLM.”

Como a Apiki ajuda na prática

Na Apiki, ajudamos lojistas a operar nessas três camadas – visibilidade, legibilidade e transacionabilidade – em três frentes de produto:

WP Host

Hospedagem WordPress gerenciada com observabilidade de bots, cache calibrado por tipo de agente, mitigação de tráfego suspeito e otimização contínua de origin hit ratio.

WP Care

Manutenção e suporte técnico contínuo, incluindo monitoramento de access log, ajuste de configurações de servidor, segurança e correção de falhas que afetam a leitura por agentes de IA.

WP Growth

Engenharia de conversão e otimização de presença em mecanismos de busca e mecanismos generativos (AEO/GEO), com auditoria de schema, feed de produto e legibilidade técnica.

Se você quer um diagnóstico inicial da presença de bots e LLMs na sua loja – quem está entrando, em qual volume, com qual taxa de sucesso – fale com nosso time comercial.

Em uma conversa de trinta minutos é possível mapear se sua operação está nas três camadas ou se há buracos abertos no momento.